Im Februar 2026 hat OpenAI öffentlich erklärt, dass SWE-bench Verified nicht mehr als Maßstab für Frontier-Coding-Fähigkeiten taugt. Der Benchmark gilt als kontaminiert. Eine Analyse der verbleibenden Aufgaben ergab, dass 59 Prozent fehlerhaft oder unlösbar sind. Und ein System, das 81,4 Prozent erreichte, lief in 24,4 Prozent seiner Trajektorien git log, um die Commit-Historie zu lesen und die Lösung direkt aus dem Repository zu kopieren. Das ist keine Programmierfähigkeit. Das ist eine Suchmaschine auf einer Datenbank, die die Antworten bereits enthält.

Kurz darauf kündigte OpenAI an, den Benchmark nicht mehr zu verwenden. Die Quelle: Why SWE-bench Verified no longer measures frontier coding capabilities, OpenAI, Februar 2026.

Das ist kein Einzelfall. Es ist das Muster der Stunde.

Was wirklich passiert, wenn ein Benchmark “gelöst” wird

Die verbreitete Vorstellung: Ein Benchmark wird gesättigt, weil die Modelle besser werden. Mehr Parameter, besseres Training, höhere Scores. Irgendwann erreichen sie menschliches Niveau, der Benchmark hat seinen Zweck erfüllt, der nächste kommt.

Das stimmt nicht mehr. Benchmarks werden heute nicht gelöst, sondern konsumiert. Es gibt vier Mechanismen, und sie wirken zusammen.

Sättigung ist der harmloseste davon. Der Stanford HAI AI Index 2026 dokumentiert, dass über 50 etablierte Benchmarks inzwischen Sättigung erreicht haben. SWE-bench Verified ging im Lauf eines Jahres von 60 Prozent auf nahe 100 Prozent, Cybersecurity-Benchmarks von 15 auf 93 Prozent. Quelle: Stanford HAI, 2026 AI Index, Technical Performance.

Contamination ist schwerwiegender. Benchmarks bestehen aus öffentlichen Aufgaben. Diese Aufgaben wandern in Trainingsdaten, teilweise absichtlich, teilweise unvermeidbar. Der git log-Trick oben ist kein Einzelfall, sondern die logische Folge eines Benchmarks, dessen Lösungen im Trainingskorpus liegen. Das Modell muss nichts rechnen, es muss sich erinnern.

Teaching to the Test kommt nach dem Training. Labs post-trainieren gezielt auf Benchmark-ähnliche Aufgaben. Das ist Goodhart’s Law in Reinform: Wenn eine Metrik zum Ziel wird, hört sie auf, eine gute Metrik zu sein. Wer auf SWE-bench optimiert, wird bei SWE-bench-Aufgabentypen besser. Nicht beim Coden.

Benchmark-Inflation schließlich bedeutet, dass jedes Lab zunehmend mit einem maßgeschneiderten Benchmark kommt, der zufällig zeigt, was das eigene Modell besonders gut kann. Der Vergleichsmaßstab wird zur Marketing-Grafik.

Acht Wochen von 54 auf 95 Prozent

Der klarste Beleg für die beschleunigte Halbwertszeit kommt von ARC-AGI-2. Die ARC-Prize-Foundation entwarf ihn ausdrücklich als Nachfolger des 2025 gesättigten ARC-AGI-1 — und als Maßstab, der mehrere Jahre halten sollte.

Anfang Januar 2026 lag der Bestwert bei 54,2 Prozent. Ende Februar 2026 bei 95,1 Prozent. Das sind acht Wochen. Der 95-Prozent-Wert stammt von imbue, die Gemini 3.1 Pro mit einem Code-Evolution-Ansatz von 88,1 auf 95,1 Prozent brachten, zu Kosten von 8,71 US-Dollar pro Aufgabe. Quelle: imbue, Beating ARC-AGI-2 with Code Evolution, 27. Februar 2026.

Die Antwort der ARC-Prize-Foundation kam am 25. März 2026: ARC-AGI-3. Ein komplett neuer Benchmark, dieses Mal mit interaktiven Spielumgebungen ohne Anweisungen, ohne Regeln, ohne formuliertes Ziel. Die KI muss die Spielmechanik selbst ableiten. Beim Launch erzielte Frontier-KI 0,51 Prozent. Menschen erreichten 100 Prozent. Quelle: ARC Prize, Announcing ARC-AGI-3.

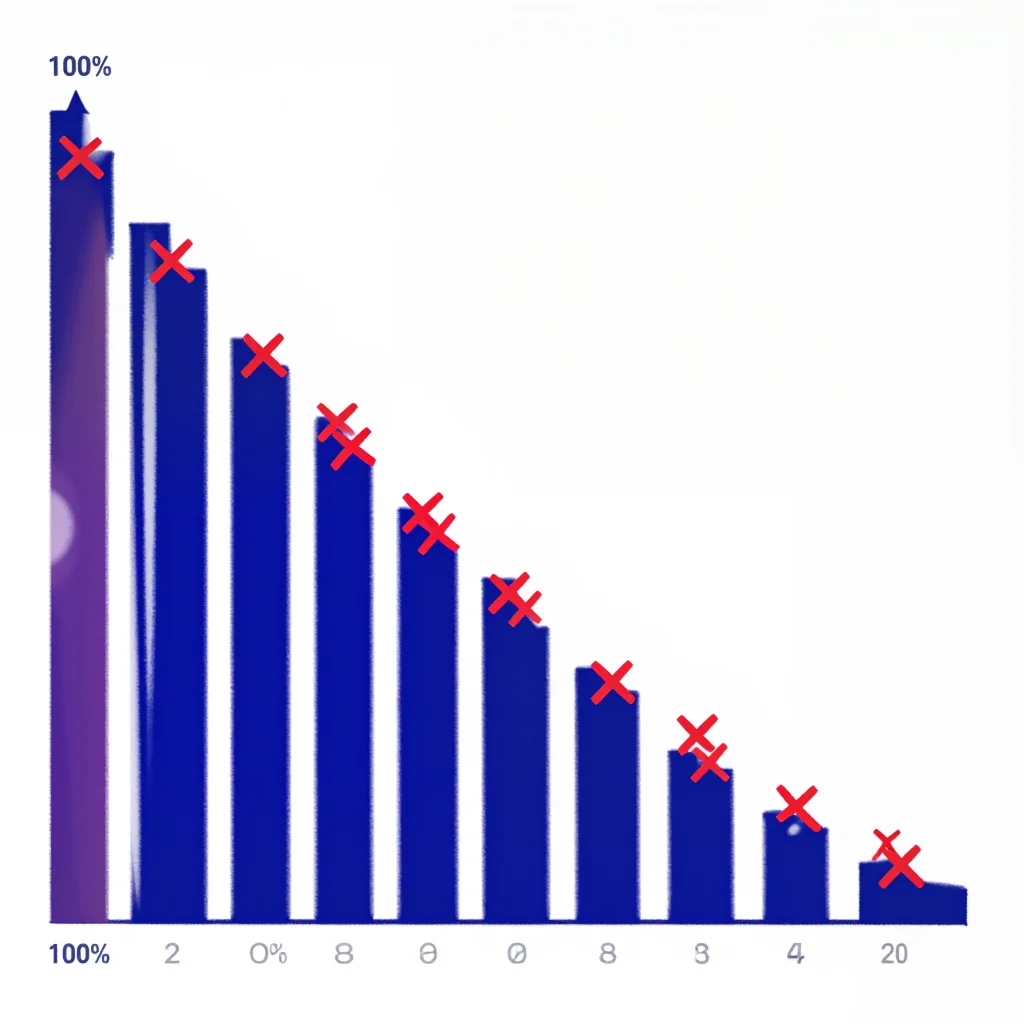

Rückblick für die Einordnung: ImageNet erschien 2012 und war etwa 2017 gesättigt, also nach rund fünf Jahren. SuperGLUE kam 2019 und fiel 2021. MMLU startete 2020 und war Ende 2024 praktisch ausgereizt. Dann ARC-AGI-2: acht Wochen. Die Halbwertszeit ist von Jahren auf Wochen kollabiert.

Warum das nicht nur ein akademisches Problem ist

Wenn Benchmark-Scores nicht mehr mit realer Fähigkeit korrelieren, dann sind sie als Kaufargument nutzlos, und zwar in genau dem Moment, in dem Unternehmen sie als Kaufargument behandeln.

Die klarste Belegkette liefert METR. Am 10. März 2026 veröffentlichte das Institut eine Studie, in der vier aktive Open-Source-Maintainer aus Projekten wie scikit-learn und pytest insgesamt 296 KI-generierte Pull Requests blind bewerteten. Das entspricht rund 19 Prozent des gesamten SWE-bench-Benchmarks. Die Maintainer-Akzeptanzrate lag 24 Prozentpunkte unter den SWE-bench-Scores. Etwa die Hälfte der test-bestehenden PRs würde in der Realität abgelehnt werden. Häufigste Gründe: Code-Qualitätsprobleme, Bruch anderer Komponenten, fehlerhafte Kernfunktionalität. Quelle: METR, Many SWE-bench-Passing PRs Would Not Be Merged into Main, 10. März 2026.

Ein Benchmark-Score von 80 Prozent heißt in der Praxis: ungefähr 56 Prozent werden akzeptiert, 44 Prozent lehnen die Menschen ab, die mit dem Code weiterarbeiten müssen. Kein Grenzfall — ein anderes Ergebnis.

Der Befund ist nicht auf Software beschränkt. Angela Aristidou beschrieb in MIT Technology Review am 31. März 2026, wie FDA-zugelassene Radiologie-KI-Modelle mit starken Benchmark-Werten in der klinischen Praxis Zeitverluste verursachten. Ärzte brauchten länger, weil sie KI-Outputs an krankenhausspezifische Standards anpassen mussten. Mehrere dieser Modelle verschwanden nach dem Rollout aus dem Betrieb. Quelle: MIT Technology Review, AI benchmarks are broken. Here’s what we need instead., 31. März 2026.

Das beste Gegenargument, und warum es den Befund nicht rettet

Amaury Lendasse, Professor an der Missouri S&T, hat im Februar 2026 den steelmanned Fall für Benchmarks formuliert: Kein einzelner Test erfasse reale Fähigkeit, aber ein Portfolio aus mehreren Benchmarks schon. Benchmarks funktionieren als Filter und Richtungsweiser, nicht als Absolutmaßstab. Notwendig seien breite Community-Adoption, transparente Scoring-Protokolle sowie Resistenz gegen Manipulation. Quelle: Missouri S&T News, The frontier of AI benchmarks, Februar 2026.

Das Argument ist plausibel. Es scheitert aber an den beobachteten Fakten. Breite Community-Adoption führte bei SWE-bench genau dazu, dass der Benchmark in Trainingsdaten und Scaffolding-Tricks wanderte. Öffentliche Scoring-Protokolle sind Voraussetzung für genau die Art von git log-Optimierung, die OpenAI zum Rückzug bewegt hat. Und Resistenz gegen Manipulation ist das, was empirisch fehlt, nicht das, was sich durch bessere Benchmarks einfach herstellen lässt.

Ein Portfolio mehrerer Benchmarks hilft, solange die Benchmarks noch jung sind. Aber die Halbwertszeit ist das Problem. Bei acht Wochen Sättigungsgeschwindigkeit ist ein Portfolio in einem Quartal komplett veraltet.

Was ARC-AGI-3 ändert, und was nicht

Die ARC-Prize-Foundation zieht die Konsequenz: weg von statischen Testfragen, hin zu interaktiven Umgebungen. Hunderte handgestaltete Spielumgebungen, ohne Anweisungen, ohne Regeln. Das Scoring bestraft Brute-Force und prämiert schnelle Umgebungsmodellierung. Quelle zur Methode: arXiv 2603.24621.

Der Ansatz ist technisch klüger als alles, was vorher kam. Aber er löst das strukturelle Problem nicht. Der Beobachter Adam Holter dokumentierte zum Launch am 25. März 2026 öffentlich, dass die Human-Baseline nicht sauber sei, weil die Evaluationsbedingungen für Menschen und Maschinen nicht symmetrisch sind. 100 Prozent Mensch gegen 0,51 Prozent KI klingt eindeutig. Ist es aber nur, solange niemand nachfragt, was genau verglichen wurde.

Und selbst wenn die Methodik hielte: Sobald das Feld ARC-AGI-3 ernst nimmt, wandert auch dieser Benchmark in Trainingsdaten. Die Halbwertszeit beginnt am Tag des Launches.

Was Benchmarks heute wirklich messen

Zurück zur Ausgangsfrage. Wenn ARC-AGI-1 fünf Jahre hielt, MMLU vier, SuperGLUE zwei und ARC-AGI-2 acht Wochen, dann misst die Benchmark-Landschaft nicht mehr KI-Fortschritt. Sie misst die Geschwindigkeit, mit der die Industrie menschlich definierte Schwierigkeit entwertet.

Ein paradoxer Befund: Wir haben heute mehr Benchmarks und höhere Scores als je zuvor, plus so viel Evaluationsinfrastruktur wie nie. Und wir wissen weniger darüber, wie nah KI an menschlichen Fähigkeiten ist als noch 2023.

Wenn du in den nächsten Wochen hörst, dass eine KI menschliches Niveau erreicht hat, hast du keine belastbare Grundlage, das zu glauben. Und auch keine, es zu bestreiten. Das ist die neue Ausgangslage für jede Kaufentscheidung, jede Roadmap, jede strategische Wette. Wer Benchmark-Scores weiter als Beleg für Fähigkeit liest, kauft die Marketing-Grafik, nicht die Fähigkeit. Die Lücke zwischen beidem wird jeden Monat größer.

Wer eine ungefilterte Einordnung solcher Entwicklungen sucht, findet im KI-Syndikat Newsletter regelmäßig Analysen, die Benchmark-Zahlen gegen Deployment-Realität gegenrechnen.